Video GANは、敵対的生成ネットワーク(GAN)の仕組みを動画に広げた生成モデルである。生成器と識別器が競い合うことで、短いノイズ(ランダムな数字)から自然に動く動画を作り出す。このモデルは、カメラが動かない状態で1秒ほどの動画を対象とし、動くもの(前景)と動かない背景がはっきり分かれている場面を想定している。

Video GAN の仕組み

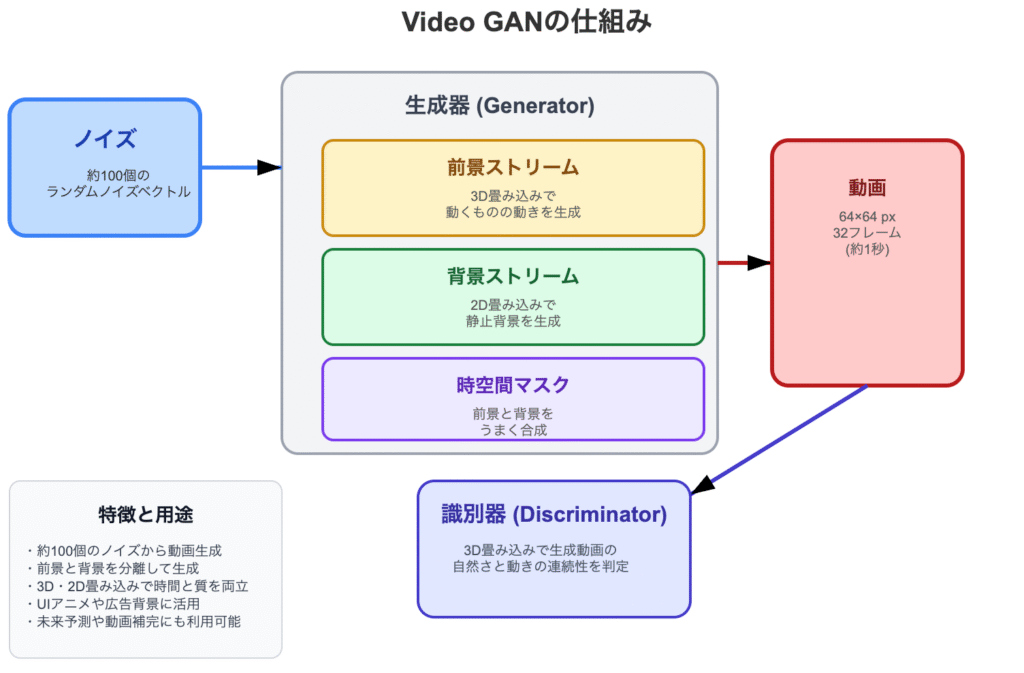

Video GANの生成器は、前景と背景の2つのネットワークから構成される。

- 前景ストリーム(流れ)図:黄色

時間も考慮しながら動くものの動きを作る。3次元畳み込みという方法で動画の動きを大きくする。 - 背景ストリーム 図:緑色

静止画を作るときと同じ2次元畳み込みで動かない背景を作る。

この2つの出力は、時空間マスク図:紫色という仕組みで合成される。

このマスクは背景と前景をうまく混ぜる役割を持つ。

識別器図:紺色は3次元畳み込みを使って、作られた動画が本物のように見えるかどうかだけでなく、動きが自然につながっているかも判断する。

Video GANの仕組み

特徴

- 約100個のノイズから、64×64ピクセル、約32フレーム(1秒程度)の動画を作れるため、少ない情報から動画を学習できる。

- 前景と背景を分けて作ることで、背景は動かさずに動くものだけを変えられる。動きのない背景がある動画に適している。

- 3次元と2次元の畳み込みを組み合わせ、時間の連続性と映像の細かさを両方考慮した動画生成が可能である。

- 1秒程度の短い動画を作れるため、未来の動きを予想したり、短い動画の足りない部分を補ったりする用途に活用されている。

提唱・開発の歴史

Video GANは2016年にMITのCarl Vondrickらによって「Generating Videos with Scene Dynamics」という論文で発表された。

彼らは敵対的生成ネットワーク(GAN)の考え方を動画に応用し、前景と背景を分離した生成器と3次元畳み込みを使って短い動画を作るモデルを提案した。この研究は、静止画像から未来の動画シーンを予測する、動画生成を通じて動きに関する知識を獲得することを目的としている。

デザイン上での利用方法

動きのあるコンテンツを素早く生成するツールとして活用できる。前景と背景を分離することで、動く部分だけを編集できるため、以下の用途に使える。

- UIアニメーションや商品の動きを試作することが可能である。

- サイトのヒーローセクションや広告バナーの動く背景や目を引く映像を作成できる。

- 潜在ベクトルや条件を変えて多様な動きを試せるため、デザイナーの参考資料として役立つ。

「この場面に使える」シーンと具体例

- 新しいアプリやデバイスの紹介動画

例として、健康管理アプリの歩数画面にキャラクターの歩く動きを生成し、背景と合成して自然なデモ動画を作成できる。 - コンテンツデザイン

飲料のキャンペーンサイトで、飲み物が注がれる泡の動きを生成し、背景写真に重ねて視覚的な魅力を高めることが可能である。 - 教育・説明シーン

電動工具の使い方を説明する動画で、動く工具と動かない作業台を別々に生成し、わかりやすいチュートリアル動画を作成できる。