Attentionは、AIが文章や画像を処理する際に、すべての情報を均等に扱うのではなく、重要な部分に「注意を向ける」仕組みである。人間が本を読むときに大事な箇所にマーカーを引くように、AIも膨大なデータの中から必要な情報を選び出して重点的に処理する。この技術により、翻訳や文章生成の精度が飛躍的に向上し、現在のChatGPTをはじめとする多くのAIサービスの基盤となっている。

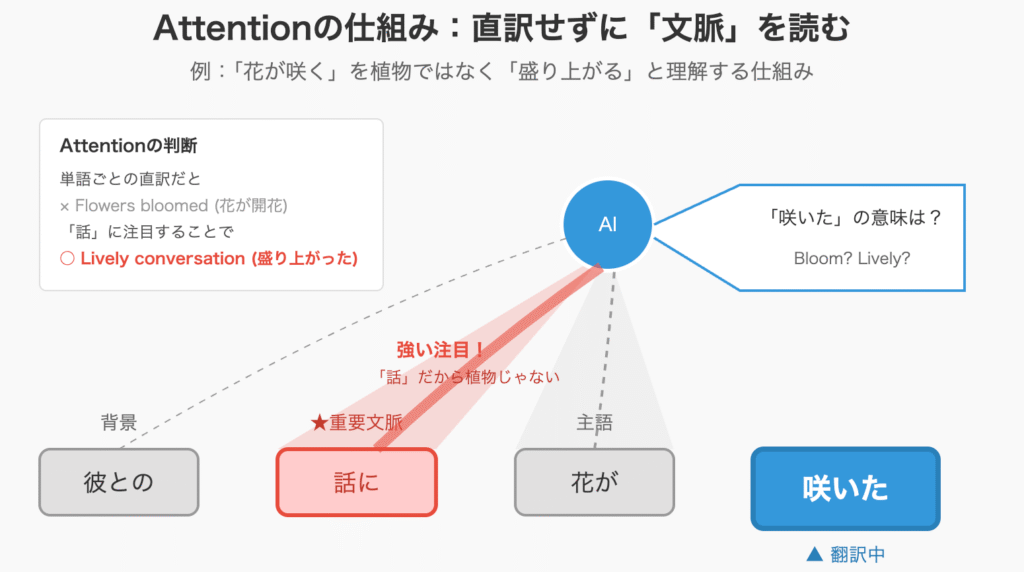

Attentionの仕組みを、具体的な翻訳の例で説明する。「彼との話に花が咲いた」という日本語を英語に翻訳する場合を考えてみよう。

従来のRNN(リカレントニューラルネットワーク)やLSTM(長短期記憶)では、文章を最初から最後まで順番に読み込み、最後に一つの「要約情報」を作って翻訳していた。このため、長い文章になると最初の方の情報が薄れてしまう問題があった。

一方、Attentionは翻訳する各単語ごとに、文中の他のどの単語と関係が深いかを計算する。

具体的には、「咲いた」という言葉を翻訳する際、AIは以下のように関連度(重み)を計算する。

- 「花が」との関連度:30点(植物のことかもしれない)

- 「話に」との関連度:90点(ここが重要!「会話」の話だ!)

- 「彼との」との関連度:20点(背景情報)

「咲いた」という言葉だけでなく、「話」という言葉に強く注目することで、AIは「これは植物の開花ではなく、会話が盛り上がったという意味だ」と判断し、“We had a lively conversation”(会話が弾んだ) と正しく翻訳することができるのである。

以下の図は、AIがこの慣用句を処理する際、どの言葉に注目して意味を決定しているかを視覚化したものである。

翻訳を例にしたAttentionの仕組み

特徴

Attentionの最大の特徴は記憶の長さに制限がないという点である。

従来のRNNでは、読んだ文章を固定サイズの記憶領域に詰め込んでいたため、長い文章になると古い情報が押し出されて消えてしまっていた。LSTMは不要な情報を忘れるように改良されたものの、固定サイズの記憶領域を使う点は変わらず、根本的な解決には至っていなかった。

Attentionは、過去のすべての単語にいつでも直接アクセスできる索引(インデックス)のような機能を持つ。文章の先頭にある単語であっても、現在処理中の単語と関係が深ければ、距離に関係なく瞬時に情報を引き出せる。これにより、翻訳精度や文脈理解力が劇的に向上した。

提唱・開発の歴史

Attentionの概念は、2014年にモントリオール大学の

-

ヂミトリ・バダナウ氏

https://rizar.github.ioより引用

-

チョ・ギョンヒョン氏

NYU Courantより引用

-

ヨシュア・ベンジオ氏

https://ja.wikipedia.org/wiki/ヨシュア・ベンジオより引用

当初は「RNNのサポーター」だった

開発当初、Attentionはあくまで主役であるRNNやLSTMを補助する役割だった。RNN(LSTM)が文章を頭から順に読んでいく際、記憶が曖昧になった部分をAttentionが補い、「元の文章のここをもう一度見て」と参照させる仕組みとして使われていた。あくまで「RNN(LSTM)+ Attention」という組み合わせが前提だったのである。

しかし、その後の研究で「そもそもRNNを使わず、Attentionだけで処理したほうが速くて正確ではないか」という発見がなされた。これが2017年のTransformer(論文名『Attention Is All You Need』)へとつながり、現在のAIの爆発的な進化を生むことになる。

デザイン上での利用方法

Attentionは「ユーザーの負担(認知負荷)を減らすための予測的なインターフェース」を構築するために利用される。

従来の検索や操作では、ユーザーが明確なキーワードを入力する必要があった。一方、Attentionの技術を応用したデザインでは、ユーザーの過去の行動や直前の操作(コンテキスト)に重み付けを行い、次にユーザーが欲しがるであろう情報を先回りして提示できる。

「この場面に使える」シーンと具体例

Attentionの「文脈を理解し、重要度を判断する」能力は、以下のようなシーンで活用できる。

| 利用シーン | 具体的なデザイン事例 | Attentionの役割 |

|---|---|---|

| ユーザーの意図を汲む検索サジェスト | ユーザーが「キャンプ」と入力した際、過去に「ファミリー向け」の商品を多く見ていれば、「ソロテント」ではなく「ファミリーテント」を優先的に表示する。 | 単なるキーワードの一致ではなく、過去の行動履歴(文脈)に高い「重み」を置いて計算し、ユーザーが潜在的に求めている情報を予測して提示する。 |

| 長文コンテンツの自動要約・ハイライト | 忙しいビジネスマン向けに、長いニュース記事の中から「その人にとって重要度が高い部分」だけを太字にしたり、3行で要約して冒頭に表示したりする。 | 記事全体を見渡し、どの文章が「結論」として他の文章と強い関連を持っているかを判断し、情報の濃淡(重要度)を可視化する。 |

| 文脈に応じたチャットボットの応答 | 「動かない」とだけ入力された場合、直前に「ログイン画面」を見ていたのか「決済画面」を見ていたのかを判断し、パスワード再設定か、カードエラー対応かを出し分ける。 | ユーザーの短い言葉だけを見るのではなく、直前の操作画面(文脈)に「注目(Attention)」することで、曖昧な言葉の真意を特定する。 |