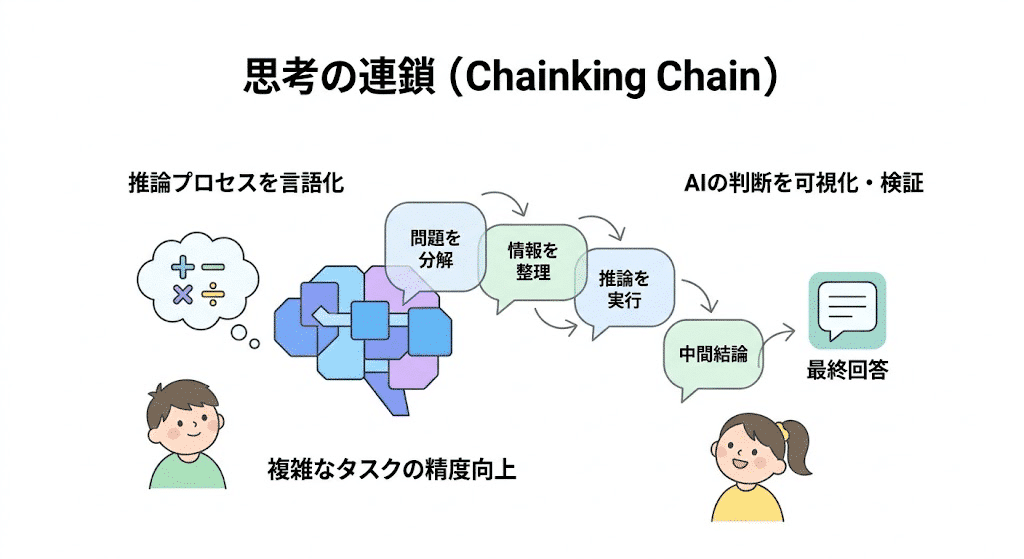

Chain-of-Thought(CoT)、すなわち「思考の連鎖」とは、大規模言語モデル(LLM)に対し、最終的な回答だけでなく、そこに至るまでの中間的な思考ステップを生成させるプロンプト技術である。これは単に答えを求めるのではなく、モデルに「どのように考えたか」を説明させることで、複雑な推論タスクの精度を向上させる。このアプローチは、AIの思考プロセスを可視化し、人間がその判断を検証・協働するための基盤を提供する。

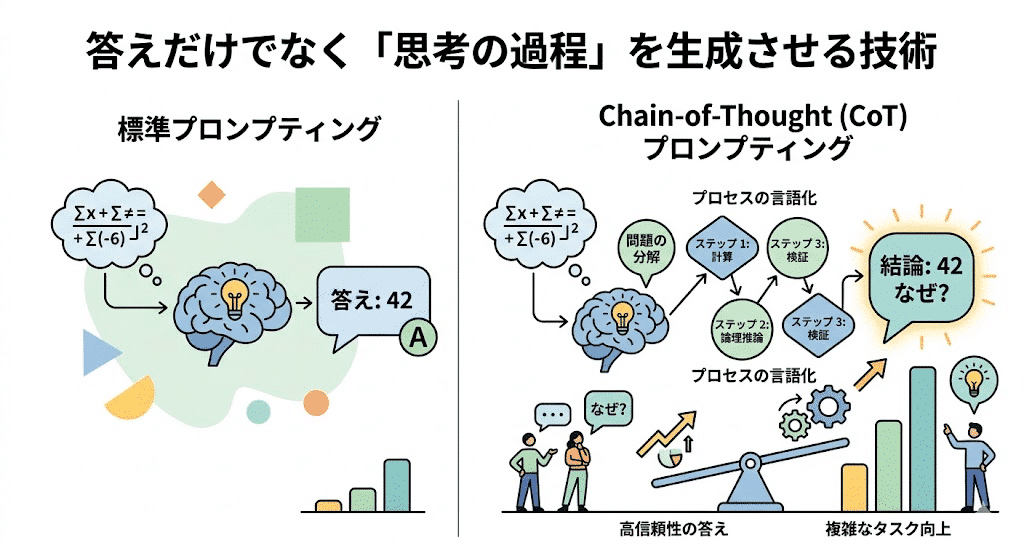

答えだけでなく「思考の過程」を生成させる技術

Chain-of-Thought(CoT)は、複雑な問題を解決可能な小さなサブタスクに分解し、それらを順に処理させることで、最終的な結論の信頼性を高めるという原理に基づいている。これは、最終的な答えだけを出力させる標準的なプロンプティングとは対照的である。モデルは「答えは何か」だけでなく「なぜその答えになるのか」というプロセスを言語化することを強制されるため、特に算術、常識、記号的推論など、多段階の思考を必要とするタスクにおいて劇的な性能向上を示す。

語源・提唱者

この概念は、2022年1月にGoogle Researchの研究者であるJason Wei、Xuezhi Wangらが発表した論文によって広く知られるようになった。当時のLLMは、複数のステップを踏む論理的な推論が苦手という課題を抱えていた。研究者たちは、人間が複雑な問題を解く際に段階的に思考を整理する点に着目し、この「思考の過程を書き出す」行為をモデルに模倣させることで、推論能力が向上するのではないかという仮説を立てた。この発見は、モデル構造を変更せずプロンプトの工夫だけで性能を引き出す画期的な手法として、プロンプトエンジニアリングの発展に大きな影響を与えた。

- シュエジー・ワン(出典:https://xzhlab.github.io/images/xz2.png)

- ジェイソン・ウェイ(出典:https://aiconference.com/wp-content/uploads/2024/04/Jason-Wei.jpg)

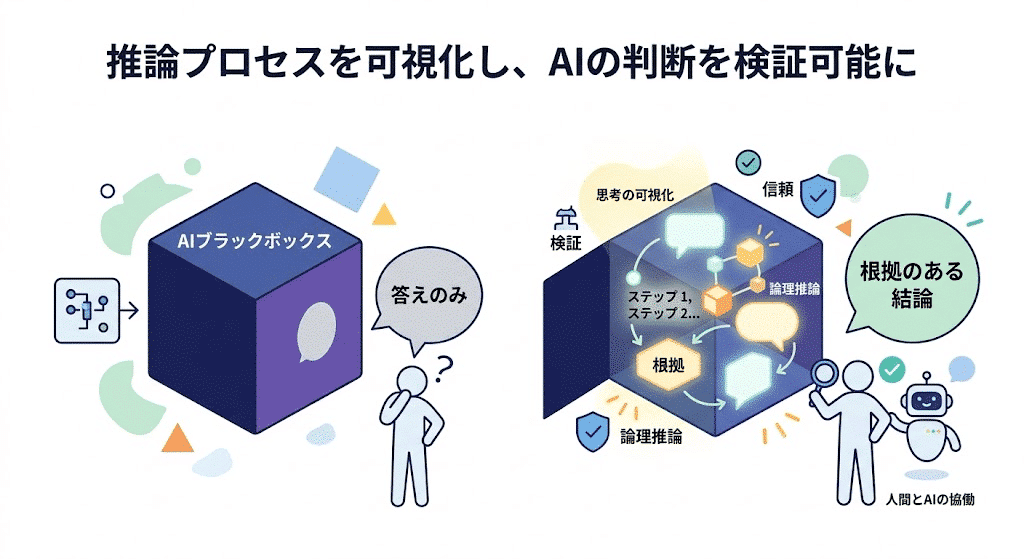

推論プロセスを可視化し、AIの判断を検証可能に

CoTの最大の価値は、AIの思考という「ブラックボックス」に光を当て、その出力の妥当性を人間が検証できるようにする点にある。思考のプロセスが言語化されるため、なぜその結論に至ったのかを追跡し、誤りがあれば特定しやすくなる。これにより、人間はAIの出力を鵜呑みにせず、批判的に検討しながら協働するための基盤を得られる。この仕組みは、主に二つの形式で実現される。

- Few-shot CoT: プロンプト内に、問題、思考の連鎖、そして最終的な答えを含む具体例を複数提示する。モデルはこの例題のフォーマットを学習し、新しい問題に対しても同様の思考プロセスをたどりながら回答を生成する。

- Zero-shot CoT: 具体例の代わりに、「ステップバイステップで考えてください(Let’s think step by step)」といった単純な指示文をプロンプトに加える。大規模なモデルであれば、この指示だけで自発的に思考プロセスを記述し、推論の精度を向上させることができる。

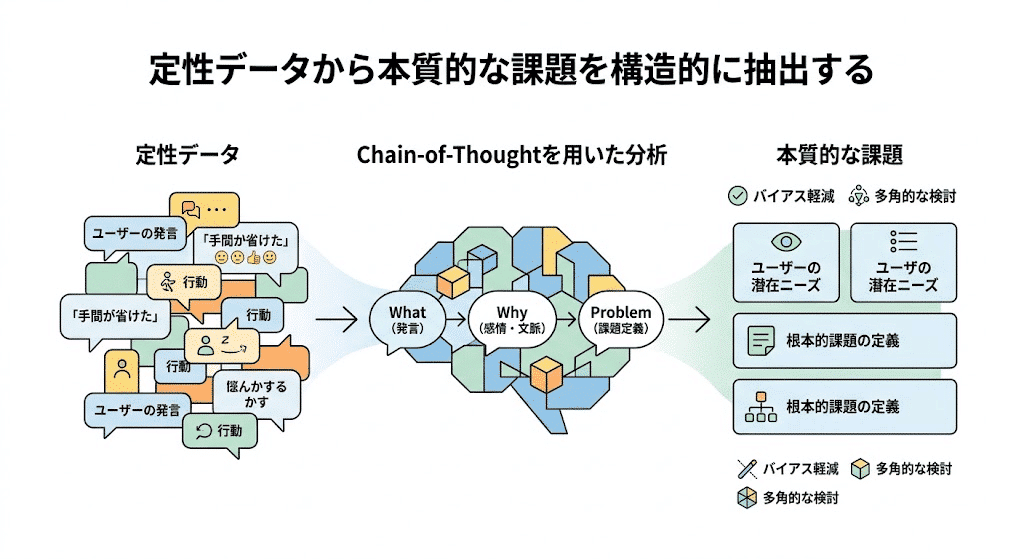

定性データから本質的な課題を構造的に抽出する

CoTは、ユーザーリサーチで得られた定性的なデータを分析し、本質的な課題を抽出するプロセスで強力な役割を果たす。特に、ユーザーインタビューの書き起こしや自由記述アンケートといった、構造化されていないテキスト情報から意味のある洞察を見つけ出す初期分析段階で有効である。ここでのCoTの役割は、単なる要約を超え、分析者の思考をシミュレートし、洞察に至るまでの論理的な道筋を構築することにある。ユーザーの発言(What)から、その背景にある文脈や感情(Why)を読み解き、最終的に解決すべき課題(Problem)を定義する思考プロセスをプロンプトとして設計することで、分析者個人のバイアスを減らし、多角的なデータ検討を支援する。

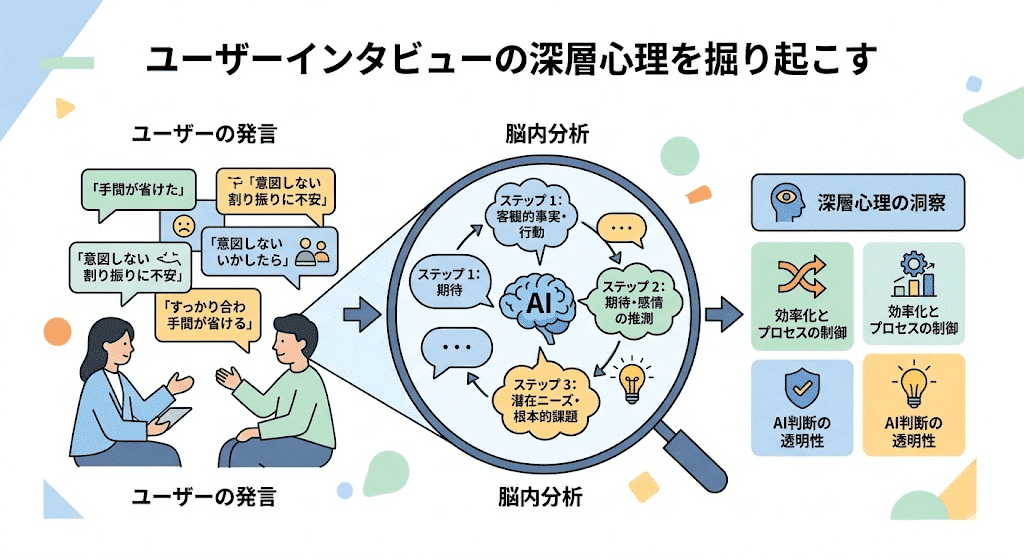

ユーザーインタビューの深層心理を掘り起こす

プロジェクト管理ツールの「AIタスク自動割り振り機能」に関するユーザーインタビューの分析シーンを想定する。発言が多岐にわたる書き起こしデータから、CoTを用いてユーザーの根本的な課題を特定する。具体的には、LLMに書き起こしを入力し、次のようなステップで思考の連鎖を生成させるプロンプトを与える。

- ステップ1: ユーザーが語った具体的な事実や行動を客観的にリストアップする。

- ステップ2: 各事実の背後にあるユーザーの期待や感情を推測する。

- ステップ3: 事実と感情を統合し、ユーザーが抱える潜在的なニーズや根本的な課題を定義する。

このプロンプトにより、モデルは「手間が省けた」という表面的な発言と、「意図しない割り振りに不安を感じた」という事実を統合し、「ユーザーは効率化を望む一方、プロセスの制御を失うことへの不安を抱えており、AIの判断を信頼できる透明性を求めている」という深層的な課題を導き出した。このように、CoTは分析的思考をモデルに強制することで、単なる要約では見過ごされがちな、矛盾する感情の中に潜む本質的なインサイトを発見する手助けとなる。

関連用語

- Few-shot Prompting

- Self-Consistency