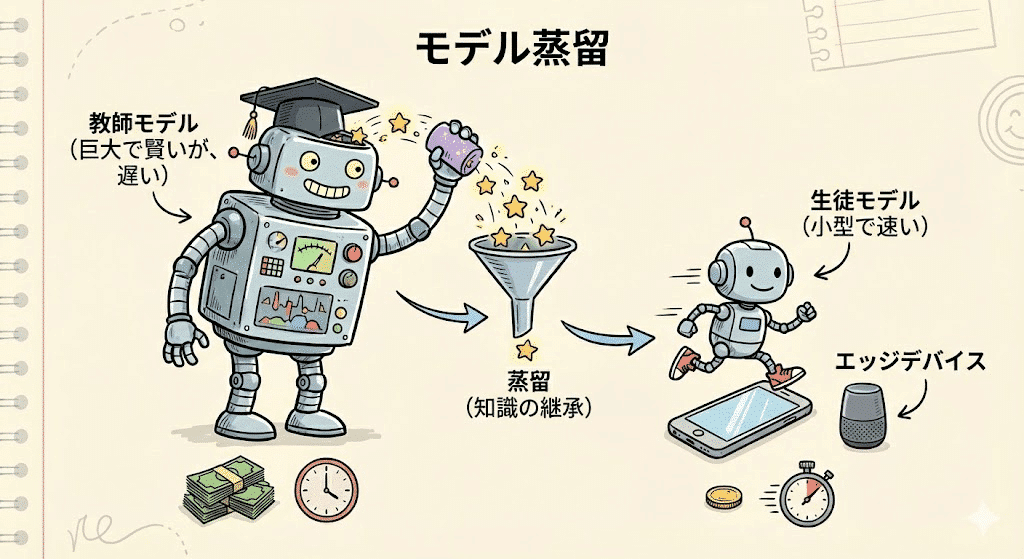

従来は大量に学習した巨大なモデルをそのまま使用していたが、コストも高く、応答が遅くなりがちだった。モデル蒸留では、高度な知識を学習した「教師モデル」がノウハウを整理し、実行専用の軽量な「生徒モデル」へ効率的に知識を継承させる。これにより、賢さを維持したまま、低コストで速いAIを使用することができる。

効率的な学習の仕組み:「正解」だけでなく「近似情報」も学習させる

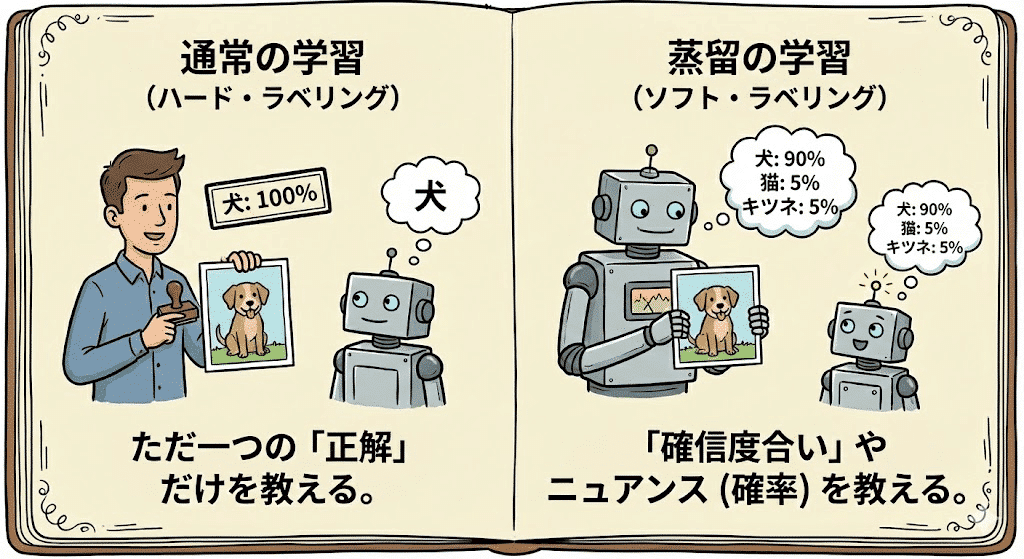

「教師モデル」から「生徒モデル」への知識継承において鍵となるのが、「ソフト・ラベリング」と呼ばれる手法である。

通常のAI学習では、犬の写真を「犬」という最終的な結果のみを教え込む。しかし、ソフト・ラベリング手法では、教師モデルが導き出した「確信の度合い」、例えば「90%犬だが、10%の確率で猫の可能性もある」といった思考のプロセスまで学習させる。

単なる正解だけでなく、「正解ではないが、何に似ているか」という近似情報(ニュアンス)と合わせて学習することで、多くのデータ(例えば100枚の犬と10枚の猫)を覚えさせるよりも少ない学習量で、教師モデルに近い高度な判断力を効率的に獲得することができる。

ハードラベリングとソフトラベリングの違い

AIをエッジ環境(スマートデバイスなど)で”即座”に動かす

モデル蒸留は、AIモデルの巨大化に伴う「運用コストの高騰」という課題を解決するために進化してきた技術である 。 かつては「精度を上げること」が最優先され、モデルは肥大化の一途をたどっていったが、現在はその揺り戻しが起きている 。

特に近年、スマートフォンやIoTデバイスなど、ユーザーの手元(エッジ環境)でAIを動かすニーズが急増している。 その場合、すべての処理を遠くのクラウドサーバーに頼るのではなく、端末内で完結させ、待たされることなく即座に応答を返す必要性がある。 この「いかに効率よく動かすか」という視点への転換は、これからのプロダクト開発における重要な競争軸になると予測されている。

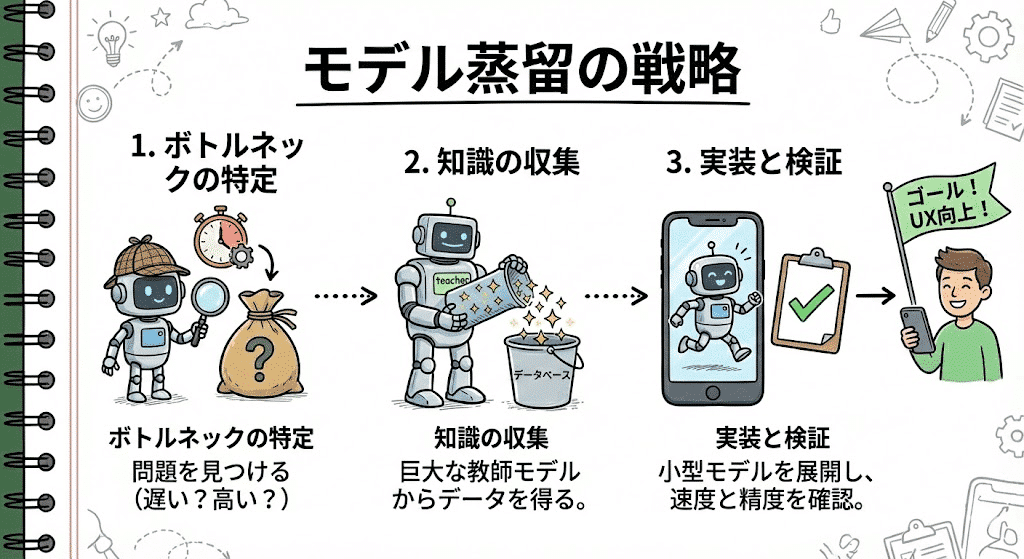

モデル蒸留導入のプロセス

モデル蒸留をビジネスに実装する際は、漫然と導入するのではなく、以下の3段階で戦略的に進めることが推奨される。

1. ボトルネックの特定(課題設定)

まず、現状の製品において「クラウドの利用料が高すぎる」のか、それとも「応答が遅すぎてユーザーが離脱している」のか、ビジネス上の弱点を明確にする 。ここでの数値目標(例:応答時間を1秒以内に短縮、コストを30%削減など)が、蒸留プロジェクトの指針となる。

2. 「知識」の蓄積(データ収集)

次に、高性能な教師モデル(LLMなど)を稼働させ、その良質な回答結果を「知識データ」として蓄積する 。特に、ユーザーから頻繁に来る質問(プロンプト)を優先的に学習させることで、最も効率よく費用対効果を高めることができる 。

3. 小型モデルの実装と評価(検証)

蓄積した知識を小型モデル(生徒)に移植し、テスト運用を行う。ここでは、狙い通りの「コスト削減・高速化」が達成できているかを確認すると同時に、小型化による「精度の低下」がユーザー体験を損なわない範囲に収まっているか、そのバランス(トレードオフ)を冷静に見極める。

具体的な活用例

AIチャットボットのコストとUX改善

カスタマーサポートの劇的な改善(コストとUXの両立) あるSaaS企業では、高精度なLLM(GPT-4o等)をチャットボットに導入したが、「回答待ち時間が平均5秒」と長く、ユーザー離脱が多発し、高額なAPI利用料が予算を圧迫していた 。 そこで、蓄積された対話データを元にモデル蒸留を行い、専用の小型モデルを作成した。

ネットワーク環境に依存しない翻訳アプリの提供

海外向け翻訳アプリや、通信環境が不安定な地域でのサービス展開において、「通信ラグ」や「圏外」は致命的な課題である 。 翻訳や要約などの機能を蒸留し、端末内(エッジ)に実装することで、ネット環境がない場所でも安定したサービス提供を可能にした。

関連用語

- エッジAI(Edge AI)

- ソフト・ラベリング(Soft Labeling)