音楽生成モデルは、人工知能を活用してメロディやハーモニー、リズムなどの音楽要素を自動で作り出す仕組みである。大量の楽曲データを学習することで、テキストやメロディの指示に応じてオリジナルの楽曲を生成できる。そのため、専門的な音楽知識がなくても気軽に楽曲制作を楽しめるのが特徴である。

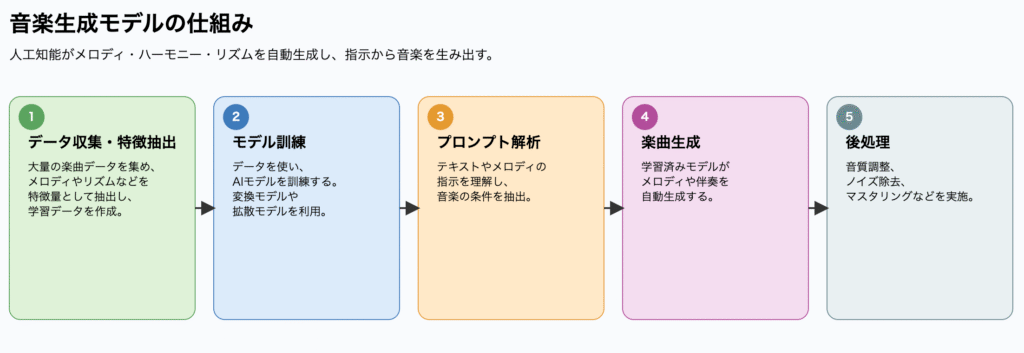

音楽生成モデルの仕組み

以下のフローで、多様なスタイルや長さの楽曲を自動生成する 。

- 膨大な音楽データを収集し、メロディ、リズム、ハーモニーなどの特徴を抽出して学習用データセットを作成する。

- 作成したデータセットを用いて、Transformerモデルや拡散モデルなどの機械学習モデルを訓練する。

- 訓練済みのモデルが、テキストやメロディなどのプロンプトを解析し、対応する音楽表現へ変換する。

- モデルが新たな楽曲を生成する。

- 生成された音源に対してオーディオ化、ノイズ除去、マスタリングなどの仕上げ処理を行う。

音楽生成モデルの仕組み

特徴

- 大量の音楽データを学習し、さまざまなジャンルやスタイルの楽曲を生成できる 。

- テキストやメロディーのスケッチなど簡単な指示から音楽を作れるため、音楽の知識がなくても作曲を楽しめる。

- 作曲支援ツールとして利用することで、アイデア出しや伴奏制作の手間を減らし、制作コストを削減できる 。

- 長時間かつ高音質な音楽を生成でき、スタイルや構造を制御する研究も進んでいる 。

提唱・発展の歴史

音楽生成モデルには特定の一人の提唱者がいるわけではなく、複数の研究者や企業によって発展してきた。

- 1950年代には、イリノイ大学の

Lejaren Hiller 氏とLeonard Isaacson 氏がコンピュータ ILLIAC I を用いて弦楽四重奏曲「Illiac Suite」を作曲した。これはコンピュータが作曲した初期の作品として知られている 。 - 1980年代には

David Koepp 氏が Experiments in Musical Intelligence (EMI) を開発し、アルゴリズム作曲の可能性を示した。 - 2010年代には Google の Magenta(1996年)や OpenAI の MuseNet(2019年)など、ディープラーニングを用いた音楽生成モデルが登場し、メロディや伴奏の生成が容易になった 。

- 2020年代にはさらに性能が向上し、Mustango や MusicLM などの拡散モデルやテキストトゥミュージックモデルが提案されている。Mustango は

Jan Melechovsky 氏らによって開発され、音楽理論の知識やコード進行を組み込むことで制御性を高めている 。

レジャレン・ヒラー氏とレナード・アイザクソン氏

https://www.last.fm/musicより引用

デザイン上での利用方法

音楽生成モデルは、動画やゲーム、アプリなどのデザインの現場で幅広く活用できる。

- 動画やゲームの背景音楽を自動で作り、作品の雰囲気を統一できる。

- 短期間で多くのバリエーションの音楽を用意できる。

- アプリやウェブサイトの動きに合わせて音楽を変化させ、ユーザー体験(UX)を豊かにできる。

実例

音楽生成モデルは動画作成にも利用されており、映像に合った音楽を手軽に制作できることから、クリエイターの表現の幅を広げるツールとして注目を集めている。

「この場面に使える」シーンと具体例

- オンボーディングやチュートリアル

サービスの初回利用時に、温かみのあるBGMを自動生成してユーザーの不安を和らげる。 - ゲームのステージBGM

プレイヤーの進行度や状況に応じてリアルタイムに音楽が変化することで、臨場感を高める。 - 動画広告やYouTubeコンテンツ

手早くオリジナルのBGMを生成し、著作権の心配なく映像と合った音楽を添える。 - インタラクティブアート作品

展示会やデジタルアートで、来場者の動きや入力に合わせて即舎的に音楽を生成する。 - リラクゼーションアプリ

瞑想や睡眠導入用のアプリで、その時の気分や時間帯に合わせた環境音楽を生成する。