Transformerは、2017年にGoogleの研究チームが発表したディープラーニング(深層学習)の技術である。

従来のAIが抱えていた「長い文章を記憶しにくい」「学習に時間がかかる」といった課題を解決し、ChatGPTやGoogle翻訳などの生成AIブームの基盤となった。

その仕組みは、文章や画像などのデータを「先頭から順に処理する」のではなく、「データ全体を一瞬で俯瞰し、要素同士の関係性を並列で計算する」というものである。

これにより、人間が文脈を読むように(文中にある)「彼」が誰を指すのか、2つの意味を持つ「bank」が、銀行なのか土手なのかを、前後の文脈から正確に理解できるようになった。

テキストや音声などの時系列データを処理するRNN(回帰型ニューラルネットワーク)やLSTM(長短期記憶)は、Attention(注意機構)によって補助されていた。このAttentionを応用して入力データ自身に注目するSelf-Attention(自己注意機構)を確立した点が革命的である。

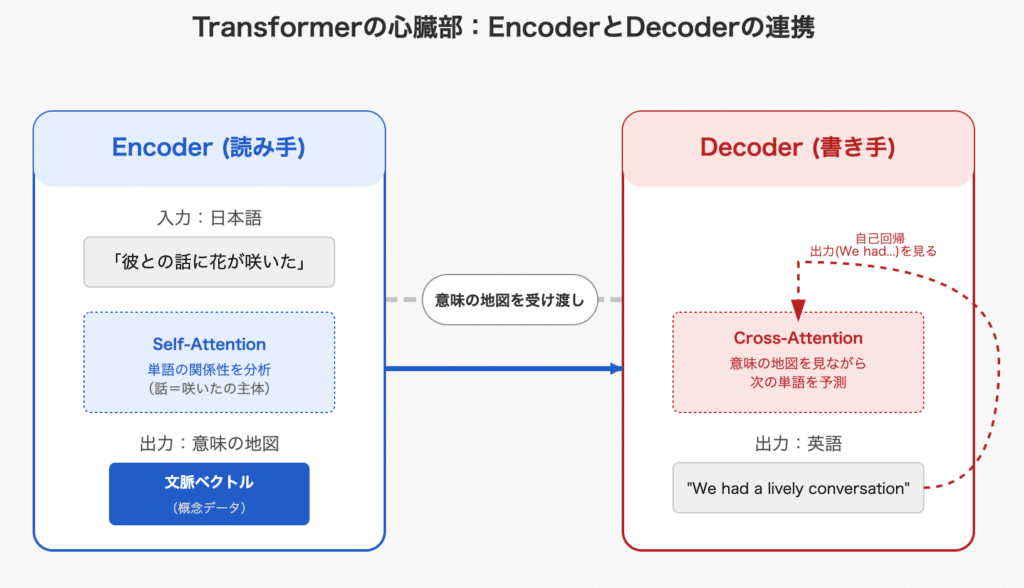

Transformerの仕組み:EncoderとDecoderの連携

Transformerの内部では、Encoder(エンコーダー)とDecoder(デコーダー)という2つの機能がチームプレーを行っている。

図のように、「彼との話に花が咲いた」を英語の”We had a lively conversation.”に訳す場合を考える。

Encoder Decoderの仕組み

- Encoder(読み手)

入力された文章を読み込み、単語同士の関係性を分析して内容を圧縮した「要約メモ(文脈ベクトル)」を作成する。入力データ自身に注目するSelf-Attentionを使い、文中のどの単語が重要かを判断する。 - Decoder(書き手)

Encoderが作成した要約メモと、自分がこれまでに生成した文章を参照しながら、次に来る単語を予測して文章を生成する。Encoderの要約情報とDecoderの生成中の文章を照らし合わせるCross-Attentionを使い、元の文脈を正確に反映した翻訳や回答を行う。

特徴

Transformerには、ビジネスやデザインに直結する3つの大きな特徴がある。

- 並列処理による高速化: 従来のモデル(RNN)は「伝言ゲーム」のように情報を順番に伝えていたため、時間がかかった。Transformerは「会議」のように全員が同時に情報を共有するため、計算が非常に速い。これにより、大規模なデータの学習が可能になった。

- 長距離の依存関係の理解: 文章の冒頭にある単語と、末尾にある単語の関係性を維持できる。これにより、長い契約書やマニュアルの要約、文脈を汲んだ翻訳の精度が飛躍的に向上した。

- 汎用性の高さ: 当初は翻訳のために開発されたが、この「関係性を見つける」仕組みは、画像(Vision Transformer:ViT)や音声解析のほか、アミノ酸同士の関係から立体的な形や働きを予測するタンパク質構造の解析にも応用できることが判明した。これらが現在のAIの多様な進化を支えている。

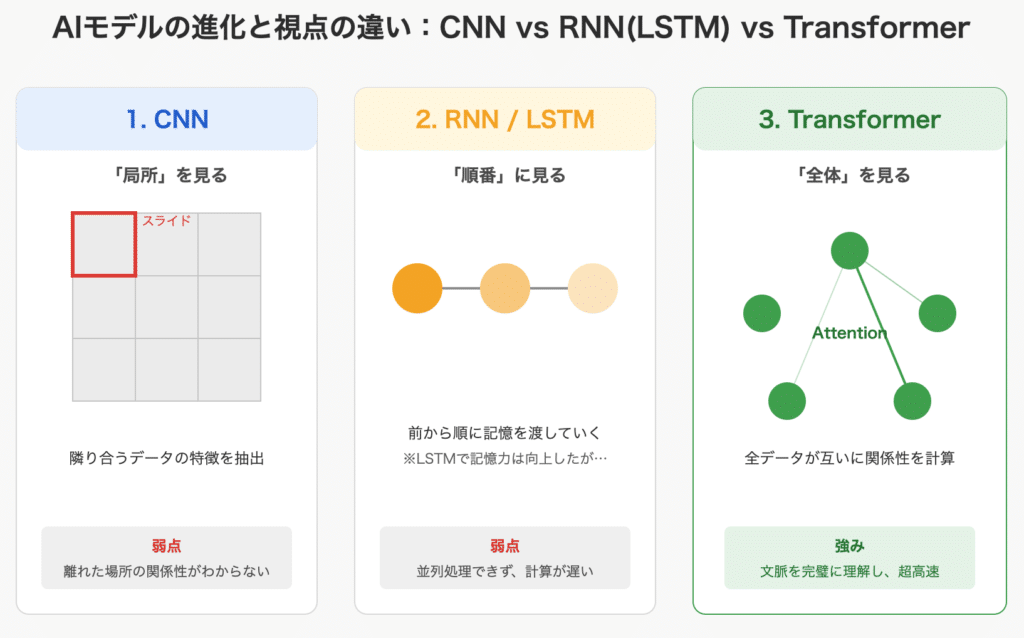

CNNとRNNの限界から誕生した

Transformerが登場する前、AI(ディープラーニング)の世界では、主に以下2つのモデルが使われていたが、それぞれに苦手な領域が存在した。

- CNN(畳み込みニューラルネットワーク)

並列処理が可能で画像認識に強いが、画像の局所的な部分しか見られず、離れた場所の関係性を捉えにくい。 - RNN(回帰型ニューラルネットワーク)

文章や音声などの時系列データに適しているが、「伝言ゲーム」のように前から順に処理するため、長い文章では最初の方を忘れてしまう問題があった。

LSTMによる改良もそれ以上の改善がされない

LSTMは、RNNの「記憶喪失」問題を解決するために改良モデルとしてが考案された。「忘却ゲート」を使い、重要な情報は保持し不要な情報は忘れる制御が可能である。

これにより、以前より長い文脈を扱えるようになったが、根本的に「前から順に計算する(逐次処理)」構造は変わらず、計算の並列化ができなかった。結果として学習に時間がかかり、超長文では文脈維持が難しい課題は解決されなかった。

CNN RNN Transformerの違い

提唱・開発の歴史

2017年、Googleの研究チーム(Google BrainおよびGoogle Research)によって発表された論文「Attention Is All You Need(必要なのはAttentionだけ)」で初めて提唱された。

この論文の著者は以下の8名である。

Ashish Vaswani Noam Shazeer Niki Parmar Jakob Uszkoreit Llion Jones Aidan N. Gomez Łukasz Kaiser Illia Polosukhin

-

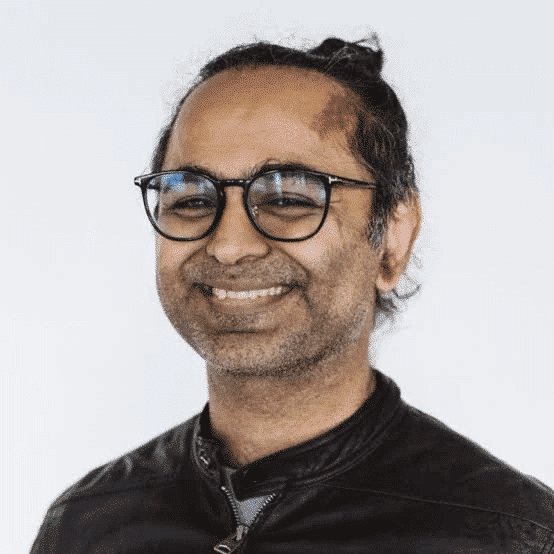

アシシュ・ヴァスワニ氏

Relation between Chat GPT and Ashish Vaswaniより引用

-

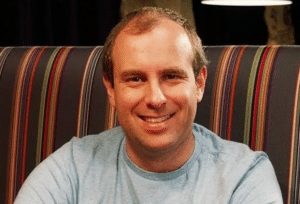

ノーム・シャジール氏

The Wall Street Journalより引用

-

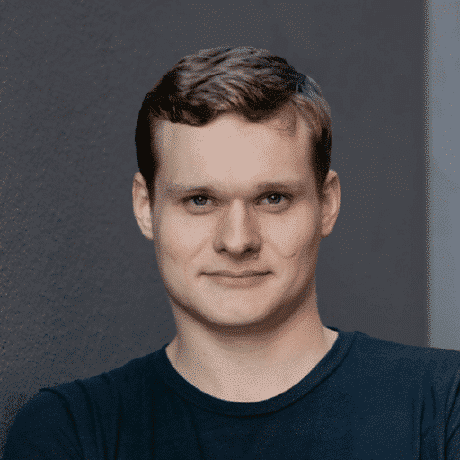

ヤコブ・ウスツコアイト氏

SynBioBetaより引用

-

ライオン・ジョーンズ氏

LinkedInより引用

-

エイダン・ゴメス氏

Wikipediaより引用

-

イリア・ポロスキン氏

GitHubより引用

彼らの多くはその後、AI分野で重要なスタートアップ(CohereやCharacter.AIなど)を創業しており、まさに現代AIの「黄金の世代」と言える。

デザイン・ビジネスでの活用

Transformerの登場は、UXデザインやビジネスプロセスに以下のような変化をもたらしている。

- 検索体験の向上:キーワードが一致しなくてもユーザーの意図を汲み取って商品を提案できる。

- 入力補助の高度化:メールやチャットで文脈に沿った返信文をAIが提案し、入力負荷を軽減する。

- 情報の要約:長文ニュースや議事録を意味を保ったまま短くまとめ、カード型UIで効率的に提示できる。

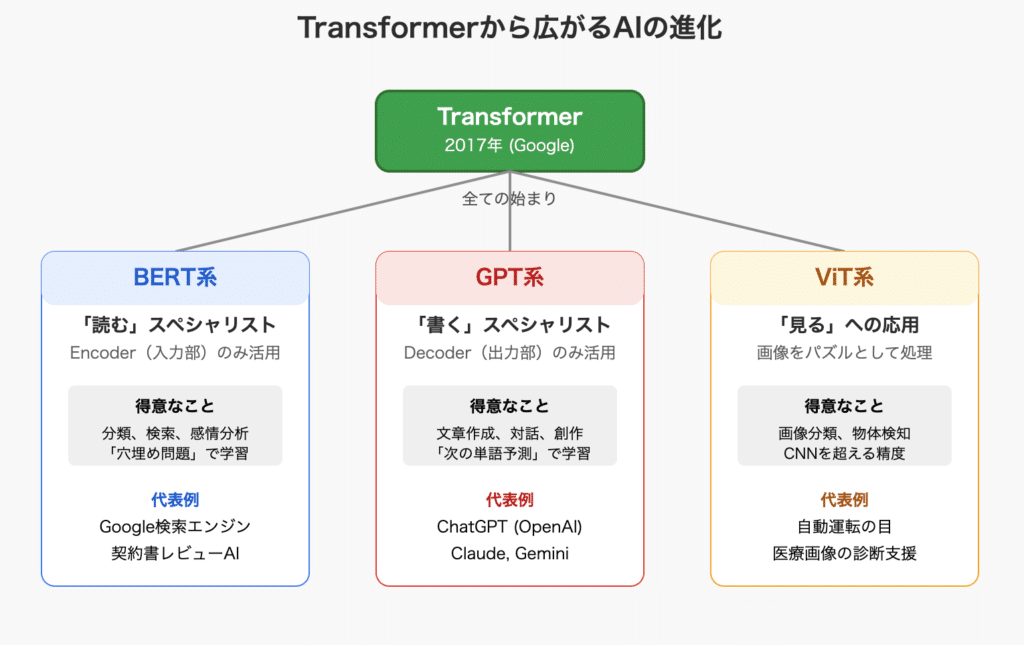

Transformerから派生した主要AIモデル

Transformerの「読む機能(Encoder)」と「書く機能(Decoder)」をそれぞれ特化させることで、現在の主要なAIモデルが誕生した。

- BERT(バート):最強の読解者

Encoder部分を強化したモデル。文章の前後の文脈を深く理解し、「穴埋め問題」で学習。Google検索や感情分析、FAQシステムに活用されている。 - GPT(ジーピーティー):最強の執筆者

Decoder部分を強化したモデル。次に来る単語を予測し続けることで流暢な文章を生成。ChatGPTなど生成AIの主役であり、カスタマーサポートにも使われている。 - ViT(ビジョン・トランスフォーマー):画像を読む

Transformerの仕組みを画像に応用。画像を小さなタイルに分割し単語のように処理。自動運転や製造業の外観検査で活用されている。

Transformerから始まるAIの進化