UX DAYS TOKYO 2017 Day1 カンファレンスの2人めの登壇者は、ケニー・ボウルズさんでした。

ケニー・ボウルズさんは、元TwitterUXマネジャーであり、デザインがどのようにビジネス的価値があるか(企業に利益をもたらすか)ということを10年来提唱している方です。執筆された記事のシリーズにDesigning with context があり、UXデザインを学ぶワークショップの教材にも使われています。

近年、社会的に認知されるようになったAI(人工知能)について、ジャーナリスティックな視点でもあり、サービスデザインの実践に伴うとても重要なトピックでした。

ユーザーの信頼を獲得する。テクノロジーは、ニュートラルか?

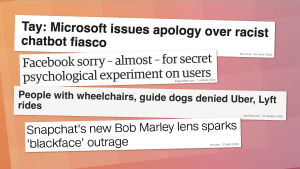

2016年におけるAI(人工知能)の失敗ニュースを見ていると、まだまだ信頼されていません。例えば、Microsoft のTay(bot)による差別発言、facebookがユーザーに嬉しくない感情操作を試みたり、Uberなどの配車サービスにおいて盲導犬や車椅子の拒否、カメラアプリSnapchatの肌色スタンプが一部の民族に対して差別的であった。。。便利になったとはいえ、「テクノロジーが中立的である」と考えることは危険であり、デザイナーが体験を設計するにあたって人命や人権(プライバシーなど)に関係する以上、UX設計者として倫理的なルールを持たないとマズイですよね?ということです。

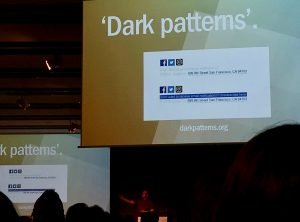

ユーザーを騙すデザイン

ダークパターン(Dark Pattern)は、ユーザーを意図して導くためのデザイン。例えば、見せたくないテキストを見えないように背景色に同化させるテクニックです。これらは、サービスの解約をさせないように、企業の戦略で指示されてユーザーを上手いこと誘導しているデザインと言えます。本当にコレで良いのか、デザイナーの倫理が問われる場面です。

自動運転のレベルで人々の行動がどう変わるのか?

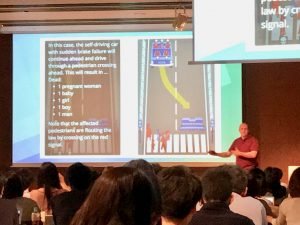

自動運転における事故の可能性を分解して考えます。「トロッコ問題」という有名な倫理学の思考実験です。全員が助かる選択肢はないとしたら、誰の命を優先すべきか(誰の命を犠牲にするのか)という選択を迫られます。歩行者を避けてハンドルを切るか?ブレーキが故障していたらどうか?同乗者の安全は?倫理的にはあまりにも想定しづらい話で、心がざわざわします。

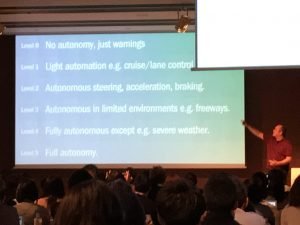

例えばメルセデスは、どんな場合も運転手の安全を優先するというポリシーです。このトロッコ問題は保険のあり方にも影響していて、運転の自動化をレベル分けして議論が進んでいるそうです。テスラのauto pilot機能はLevel3程度で、ネーミングは感覚的にイケてそうですが安全性を保証してるものではありませんね。

基調講演を受けて

デザインが倫理的であるかどうかの「倫理テスト」も示されました。デザイナーがプロダクトやサービスを考えていく上で陥る倫理的ジレンマ。サービスの成長には社会的責任が伴い、企業側の倫理が問われます。卓上の理論ではなく課題を分解して考え、実証実験を行い、大なり小なりプロジェクト単位で共通の意識を持ちたいと思います。かなり重たいテーマでしたが、それらも含めてデザイナーも認識すべき内容ということがわかりました。